دانلود شبیه سازی مقاله الگوریتم جستجوی گرانشی و بهینه سازی ازدحام ذرات مبتنی بر ضریب انقباض ترکیبی

| عنوان فارسی |

یک الگوریتم جستجوی گرانشی و بهینه سازی ازدحام ذرات مبتنی بر ضریب انقباض ترکیبی برای آموزش پرسپترون چند لایه |

| عنوان انگلیسی |

A hybrid constriction coefficient-based particle swarm optimization and gravitational search algorithm for training multi-layer perceptron |

| کلمات کلیدی |

شبکه عصبی؛ شبکه عصبی پیشخور (FNN)؛ الگوریتم جستجوی گرانشی (GSA)؛ بهینه سازی ازدحام ذرات (PSO)؛ هیبریداسیون؛ CPSOGSA؛ پرسپترون چند لایه (MLP) |

| درسهای مرتبط |

الگوریتم های بهینه سازی |

| تعداد صفحات انگلیسی : 37 | نشریه : Emerald |

| سال انتشار : 2020 | تعداد رفرنس مقاله : 74 |

| فرمت مقاله انگلیسی : PDF | نوع مقاله : ISI |

| آیا این مقاله برای بیس پایان نامه مناسب است؟ : بله | آیا این مقاله برای ارائه کلاسی مناسب است؟ : بله |

| برنامه ای که در آن مقاله شبیه سازی شده است : این مقاله در محیط متلب پیاده سازی شده است | نام مجله مقاله : International Journal of Intelligent Computing and Cybernetics (مجله بین المللی سایبرنتیک و رایانش هوشمند) |

| ترجمه: ندارد | گزارشکار : ندارد | شبیه سازی : دارد (فایل های شبیه سازی در نرم افزار متلب با فرمت .m) |

این مقاله در محیط متلب به صورت کامل شبیه سازی شده و در صورت خرید و دانلود مقاله شما به راحتی قادر خواهید بود از برنامه مربوطه استفاده نمایید. در صورت بروز هر گونه مشکل در نحوه ی اجرای برنامه سایت سیگمالند به مدت 24 ساعت بعد از خرید محصول، پشتیبانی آن را تا اجرای کامل برعهده دارد.

پروژه متلب PSO بر پایه ضریب انقباض ترکیبی

در این مقاله، یک الگوریتم هیبریداسیون جدید پیشنهادی تحت عنوان بهینه سازی ازدحام ذرات مبتنی بر ضریب انقباض و الگوریتم جستجوی گرانشی (CPSOGSA) برای آموزش MLP با هدف غلبه بر حساسیت به مقداردهی اولیه، همگرایی زودرس و ایستایی/ رکود در مسائل بهینه محلی MLP مورد استفاده قرار می گیرد.

در این تحقیق، اکتشاف فضای جستجو با الگوریتم جستجوی گرانشی (GSA) و بهینهسازی راه حل های انتخابی، یعنی بهره برداری با بهینه سازی ازدحام ذرات (PSO) انجام می گیرد. همچنین در این پروژه، برای آموزش پرسپترون چند لایه ای (MLP)، تابع CPSOGSA جهت یافتن ترکیب مناسب وزن های اتصال و سوگیری های عصبی برای به حداقل رساندن خطا، از تابع تناسب سیگموئید استفاده می کند. علاوه بر این، یک استراتژی رمزگذاری ماتریسی در مرحله دوم به منظور ارائه تناظر یک به یک بین وزن ها و سوگیری های MLP و عوامل CPSOGSA مورد استفاده قرار می گیرد.

یافتههای تجربی حاکی از آن است که CPSOGSA در مقایسه با سایر الگوریتم های تصادفی، آموزش دهنده MLP بهتری است، زیرا از نظر رفع رکود/ ایستایی در مسائل بهینه محلی و سرعت همگرایی، نتایج برتری را ارائه میدهد. همچنین، در مقایسه با سایر الگوریتمهای مشارکت کننده، بهترین نتایج را برای مجموعه دادههای سرطان سینه، قلب، عملکرد سینوسی و عملکرد سیگموئید ارائه میدهد. همچنین لازم به ذکر است که، CPSOGSA نتایج بسیار رقابتی را برای سایر مجموعه داده ها نیز ارائه می دهد.

CPSOGSA در زمینه رفع رکود/ ایستایی در مسئله بهینه محلی و افزایش سرعت همگرایی کلی MLP از عملکرد موثری برخوردار است. در اصل، CPSOGSA یک الگوریتم بهینهسازی ترکیبی است که در زمینه قابلیت اکتشاف سراسری و قدرت بهرهبرداری محلی از ویژگیهای قدرتمندی برخوردار است. علاوه بر این تحقیقات اندکی در زمینه استفاده از CPSO و GSA برای آموزش MLP در دسترس می باشد. تنها مقاله پژوهشی مرتبط در این زمینه توسط میرجلیلی و همکاران در سال 2012 ارائه شده است. آنها در مطالعه خود برای آموزش FNNهای ساده از PSO و GSA استاندارد استفاده کردند. با این وجود، در این مقاله برای ارزیابی کارایی الگوریتمها تنها از سه مجموعه داده و معیار عملکرد MSE استفاده شده است. همچنین، در این مطالعه برای بررسی اثربخشی CPSOGSA در آموزش MLP ها، هشت مجموعه داده استاندارد مختلف و پنج معیار عملکرد مورد استفاده قرار گرفته است. علاوه بر این، برای اعتبارسنجی آماری نتایج شبیهسازی، یک آزمون آماری زوجی غیرپارامتری تحت عنوان آزمون مجموع رتبه ای ویلکاکسون در سطح معناداری 5 درصد انجام شده است. همچنین، برای افزایش صحت تنظیمات عملی، هشت الگوریتم فراابتکاری پیشرفته برای تحلیل مقایسه ای نتایج تجربی نیز مورد استفاده قرار گرفت.

شبکه عصبی (NN)، یکی از بهترین ابزارهای محاسباتی است که در زمینه محاسبات نرم مورد استفاده قرار می گیرد. مک کالوچ و پیتس (1943) اولین محققانی بودند که یک مدل محاسباتی برای شبکه های عصبی را ارائه کردند. در حال حاضر در بین محققان، شبکه های عصبی از محبوبیت فزاینده ای برخوردار هستند. همچنین، NN ها دارای ویژگی های سادگی ریاضیاتی، اثربخشی بالا و هزینه محاسباتی پایین هستند. انواع مختلفی از شبکه های عصبی نظیر شبکه عصبی بازگشتی (RNN) ، شبکه خود سازماندهی کوهونن، شبکه عصبی پیشخور (FNN) و تابع پایه شعاعی (RBF) وجود دارد. FNN ساده ترین شبکه عصبی است که در آن اطلاعات به صورت یک طرفه از گره های ورودی به خروجی حرکت می کند. معمولاً FNN به پرسپترون تک لایه ای (SLP) و پرسپترون چند لایه ای (MLP) طبقه بندی می شود. همچنین، در SLP، یک لایه ورودی، تنها دارای یک لایه پنهان (در صورت وجود) و لایه خروجی است. همچنین در هر گره، حاصلضرب ورودی و وزن مورد محاسبه قرار می گیرد. همچنین در صورتیکه مقدار بیشتر از آستانه باشد، اقداماتی نیز انجام می گیرد. لازم به ذکر است که برای یافتن الگوهای قابل جداسازی خطی در داده ها از SLP استفاده می شود. از سوی دیگر، MLP از یک لایه ورودی، یک یا چند لایه پنهان و یک لایه خروجی تشکیل شده است. در حقیقت، تابع سیگموئید به دلیل ماهیت پیوسته آن به طور کلی به عنوان تابع برازش در MLP استفاده می شود. همچنین، MLP جهت طبقه بندی داده ها در سیستم های غیر خطی نیز مورد استفاده قرار می گیرد.

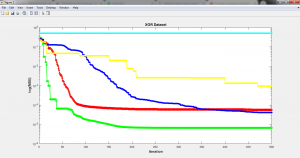

این مقاله مربوط به سال 2020 بوده و شبیه سازی آن در محیط نرم افزار متلب (MATLAB) انجام شده است. در ادامه نیز تصویر مربوط به خروجی شبیه سازی قرار داده شده است:

دیدگاهها

هیچ دیدگاهی برای این محصول نوشته نشده است.